De huisarts schreef het af als hyperventilatie. De AI-triage had een longembolie gesuggereerd. De patiënt overleed drie dagen later. Dit scenario is geen fictie, het speelt nu al in rechtszalen. Met de nieuwe Menzis-richtlijnen voor 2026 en een groeiend tekort aan assistenten wordt AI-triage steeds vaker onderdeel van de dagelijkse praktijk. De vraag die niemand beantwoord heeft: wie draagt de juridische verantwoordelijkheid als de technologie het fout heeft?

De druk op huisartsen: waarom AI-telefonie nu oprukt

De cijfers liegen niet. Het aandeel patiënten met chronische aandoeningen groeit, de vergrijzing zet door, en het tekort aan ondersteunend personeel is structureel. Voor veel huisartsenpraktijken is telefonische bereikbaarheid het eerste knelpunt dat sneuvelt.

Toen kwam COVID.

Tijdens de pandemie deed 60% van de huisartsenpraktijken vaker telefonische consulten. 70% paste beeldbellen intensiever toe. Wat daarvoor ondenkbaar leek, werd binnen weken de standaard. Uit onderzoek naar digitale zorg-enablers bleek dat 90% van de ziekenhuizen verwachtte dat deze digitalisering blijvend zou zijn.

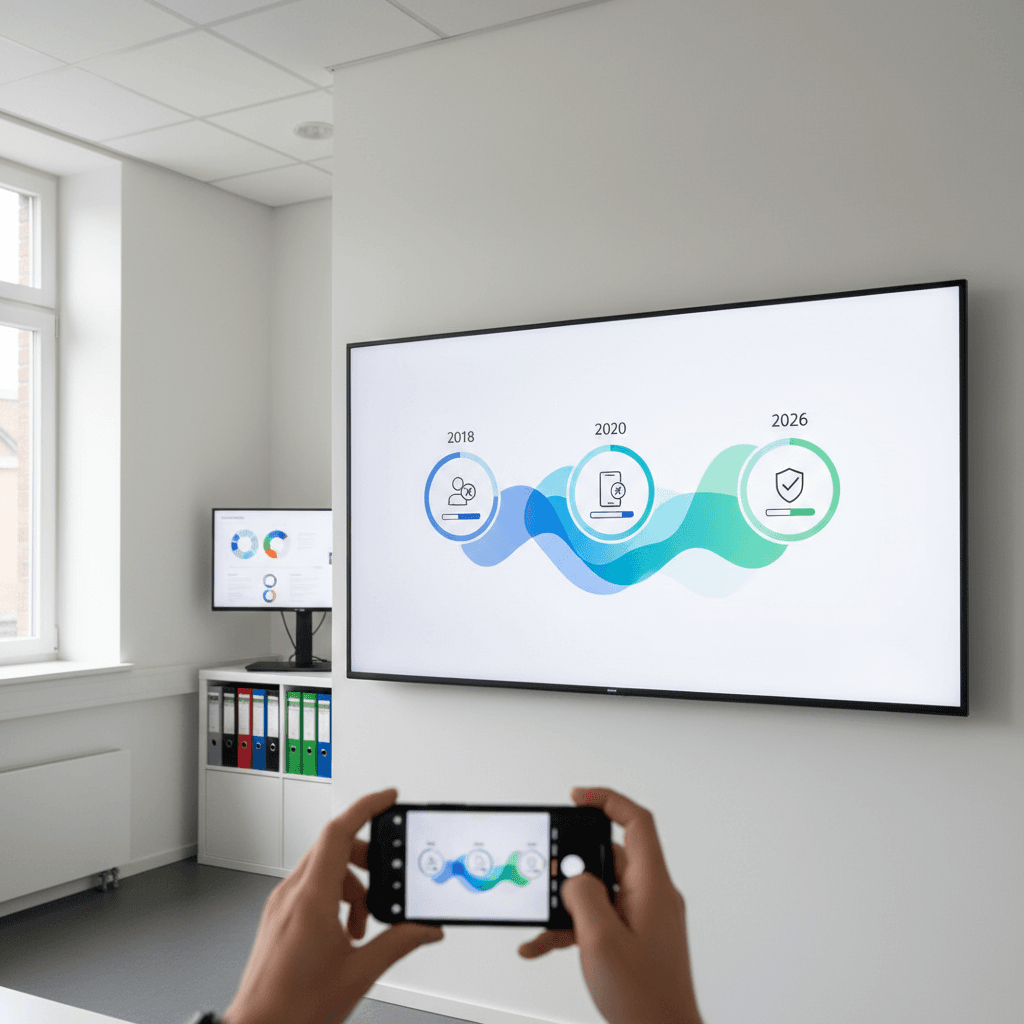

In 2018 verwachtte geen enkele huisarts dat videoconsult tot de mogelijkheden zou behoren. Twee maanden na de COVID-uitbraak was digitale zorg de nieuwe norm.

De verschuiving ging sneller dan wie dan ook had voorspeld. En de druk neemt alleen maar toe. Het Menzis Zorginkoopbeleid 2026 maakt de richting expliciet: "Digitaal als het kan" naast "Zelf als het kan" en "Thuis als het kan". Verzekeraars duwen, capaciteitsproblemen trekken. AI-telefonie is niet langer een experiment voor early adopters. Het is een logisch antwoord op een onhoudbare situatie.

De vraag is niet meer óf praktijken digitaliseren. De vraag is hoe snel, en onder welke voorwaarden.

"Van ondenkbaar naar onvermijdelijk in twee jaar tijd."

Menzis 2026: 'Digitaal als het kan' als inkoopvoorwaarde

Het Zorginkoopbeleid 2026 van Menzis maakt de koers onomwonden duidelijk. Drie pijlers vormen de basis: "Digitaal als het kan", "Zelf als het kan" en "Thuis als het kan". Passende zorg is het doel. Digitalisering is het middel.

Voor huisartsenpraktijken verandert dit de spelregels. AI-telefonie en digitale triage zijn niet langer interne keuzes over efficiëntie. Ze worden inkoopvoorwaarden. Verzekeraars kijken naar hoe praktijken hun capaciteit inzetten, en digitale oplossingen wegen mee in die beoordeling.

De beweging is logisch. Minder administratieve druk, kortere wachttijden, betere bereikbaarheid. Op papier klopt het verhaal. Maar de praktijk is weerbarstiger.

Hier ontstaat de spanning. Verzekeraars stimuleren digitalisering, maar het wetenschappelijk bewijs voor effectiviteit van AI-toepassingen in de huisartsenzorg is nog beperkt. Het NHG signaleert veelbelovende kansen, maar plaatst tegelijkertijd kanttekeningen bij de onderbouwing. De huisarts blijft medisch eindverantwoordelijk voor elke triageuitkomst, ook wanneer een algoritme de eerste inschatting maakt.

De rekening van een verkeerde triage belandt niet bij de verzekeraar. Die ligt bij de praktijk. En uiteindelijk bij de patiënt.

Praktijken staan voor een dubbele druk: meebewegen met inkoopeisen, maar tegelijk het risico dragen van technologie die zich nog moet bewijzen.

Het Belgische precedent: AI-triage als onwettige geneeskunde?

In België woedt een juridische discussie die ook voor Nederland relevant is. De vraag: wanneer maakt een "derde" een medische inschatting? En is dat onwettige uitoefening van geneeskunde?

Het onderscheid lijkt helder. Administratieve intake is vragen stellen en doorverbinden. Medische triage is inschatten hoe urgent een klacht is en welke zorg nodig is. Dat laatste is voorbehouden aan zorgprofessionals. Maar AI-systemen bewegen zich precies op die grens.

Een callcenter dat vraagt "waarvoor belt u?" doet iets anders dan een algoritme dat op basis van symptomen een urgentiecode toekent. De eerste noteert. De tweede beoordeelt. En die beoordeling is het probleem.

De Belgische discussie legt de vinger op de zere plek. Zodra een AI-systeem beslist dat klacht A urgenter is dan klacht B, maakt het een medische inschatting. Zonder BIG-registratie. Zonder tuchtrecht. Zonder de verantwoordelijkheid die bij medisch handelen hoort.

Voor Nederland is dit geen ver-van-mijn-bed-show. De Wet BIG kent vergelijkbare bepalingen rond voorbehouden handelingen. De huisarts blijft medisch eindverantwoordelijk, ook wanneer een algoritme de eerste selectie maakt. Maar wat als dat algoritme systematisch verkeerde prioriteiten stelt? Wie draagt dan de consequenties?

De Belgische casus maakt één ding duidelijk: de juridische kaders lopen achter op de technologie. En die kloof wordt elke dag groter.

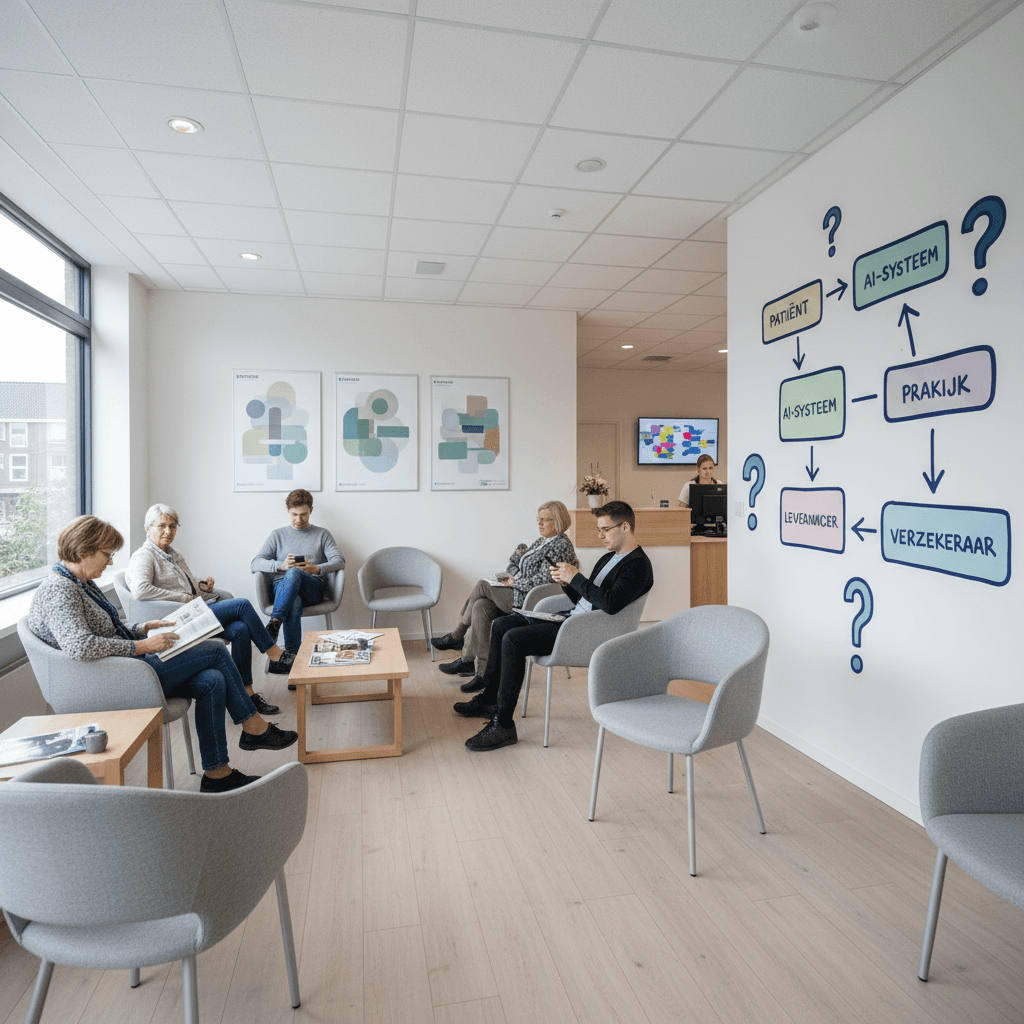

De aansprakelijkheidsvraag: huisarts, leverancier of beiden?

De juridische werkelijkheid is helder op één punt: de huisarts blijft medisch eindverantwoordelijk. Delegatie aan een systeem of medewerker verandert daar niets aan. De BIG-registratie bepaalt wie de rekening krijgt als het misgaat.

Maar er zit een tweede laag onder.

Productaansprakelijkheid. Wanneer een AI-systeem technisch faalt, wanneer het algoritme aantoonbaar gebrekkig is getraind, of wanneer de software structureel verkeerde uitkomsten geeft, komt de leverancier in beeld. De Europese richtlijnen voor productaansprakelijkheid zijn daar steeds duidelijker over.

Het echte grijze gebied ligt ergens in het midden. Wat als de AI correct functioneert volgens specificaties, maar de patiënt de uitkomst verkeerd interpreteert? Wat als een edge case opduikt die niet in de trainingsdata zat? De technologie deed precies wat beloofd was. De uitkomst was alsnog fataal.

In de rechtszaal worden dit de lastigste zaken.

Praktijken die nu AI-telefonie implementeren, doen er goed aan de contractuele afspraken met leveranciers onder de loep te nemen. Wie draagt welk risico? Wat zijn de garanties rondom algoritme-updates? Hoe is de aansprakelijkheid verdeeld bij grensgevallen?

De meeste standaardcontracten geven hier geen sluitend antwoord op. Dat maakt onderhandeling over specifieke clausules geen luxe, maar noodzaak.

De aansprakelijkheidsketen van patiënt naar praktijk naar leverancier naar verzekeraar zit vol vraagtekens. En die vraagtekens worden pas beantwoord als de eerste rechtszaken zijn uitgevochten.

NHG-waarschuwing: veelbelovend, maar bewijs nog beperkt

Het NHG ziet kansen, maar plaatst een stevige kanttekening. In hun overzicht van AI in de huisartsenpraktijk is de boodschap helder: het wetenschappelijk bewijs voor effectiviteit van AI-toepassingen in de huisartsenzorg is nog beperkt. Veelbelovend? Ja. Bewezen? Nog niet.

Voor early adopters heeft dit directe consequenties. Implementeren zonder robuuste evidence base vergroot het juridische risico bij calamiteiten. De rechter kijkt naar wat gangbaar en verdedigbaar is. Technologie die de beroepsgroep zelf als onbewezen bestempelt, is moeilijk te verdedigen.

De praktijken die nu succesvol AI inzetten, gebruiken het voor ondersteuning. Niet voor autonome medische beslissingen.

De oplossing ligt in de afbakening. AI-systemen die via HIS-koppelingen integreren, kunnen agenda's beheren, administratie verwerken en gesprekken doorverbinden. Ze ondersteunen in meerdere talen, van Nederlands tot Spaans. Allemaal zonder medische oordelen te vellen.

Het verschil is cruciaal. Een systeem dat vraagt "voor welke arts belt u?" doet iets anders dan een algoritme dat bepaalt of uw klacht vandaag of volgende week gezien moet worden. Het eerste is logistiek. Het tweede is geneeskunde.

Praktijken die deze grens respecteren, combineren efficiëntiewinst met juridische houdbaarheid. De AI assisteert. De zorgprofessional beslist.

Praktisch advies: AI adopteren zonder juridisch risico

De praktijken die nu succesvol AI inzetten, hebben één ding gemeen: ze trekken een heldere grens tussen administratieve ondersteuning en medische triage. Die scheidslijn bepaalt het juridische risico.

-

Administratief versus medisch: AI die telefoons beantwoordt, agenda's beheert en doorverbindt naar de juiste medewerker, blijft binnen veilige juridische kaders. Zodra een systeem symptomen beoordeelt of urgentie inschat, betreed je het domein van geneeskunde. De koplopers houden die grens scherp.

-

Menselijke escalatie als vangnet: Elke interactie waarbij een medische vraag opduikt, moet direct naar een bevoegde medewerker kunnen. Duidelijke protocollen en korte lijnen maken het verschil tussen een werkend systeem en een aansprakelijkheidsrisico.

-

Documentatie als bescherming: Praktijken die AI-interacties vastleggen en periodiek auditen, staan sterker bij claims. Het toont due diligence. Het bewijst dat de praktijk bewust omgaat met de technologie.

-

Resultaten uit de praktijk: Praktijken die AI inzetten voor niet-medische taken, zoals het beantwoorden van standaardvragen over openingstijden of het doorverbinden naar de juiste lijn, rapporteren tot 80% minder druk op assistentes. De winst zit in repetitieve handelingen, niet in medische oordeelsvorming.

De les is helder: efficiëntie en juridische houdbaarheid gaan samen, mits de grenzen duidelijk zijn.

Benieuwd hoe AI-telefonie uw praktijk ontlast zonder juridische risico's? Ontdek onze oplossing voor huisartsen en vraag een vrijblijvende demo aan.